Aufgaben eines modernen Monitorings (1)

Monitoring ist die unmittelbare systematische Erfassung, Beobachtung oder Überwachung eines Vorgangs oder Prozesses mittels technischer Hilfsmittel. So schlicht die Definition ist, so komplex sind die Missverständnisse, die dieses Thema zwischen Business und IT aufwirft. Dabei hilft richtig verstandenes und betriebenes Monitoring Unternehmen in allen Geschäftsbereichen. Im ersten Teil dieses Artikels wagen wir uns an eine Bestandsaufnahme, die nächsten Folgen gehen dann auf die Aufgaben des Monitorings, die Anforderungen an Überwachungswerkzeuge und Monitoring in der Cloud ein.

Die Informations- und Kommunikationstechnologie (IKT) stellt einen elementaren Bestandteil des alltäglichen Lebens und des Wirtschaftshandelns dar. Daher gehört in einer globalisierten und vernetzten Welt eine leistungsfähige und dauerhaft verfügbare IKT zu den wichtigsten Grundvoraussetzungen für die Wettbewerbsfähigkeit der Unternehmen. IT-Abteilungen sehen sich heute mit den unterschiedlichsten Anforderungen konfrontiert:

- Es sollen die Geschäftsprozesse unterstützt werden,

- es muss dafür gesorgt werden, dass gesetzliche Vorschriften eingehalten werden

- und es soll ein messbarer Wertbeitrag für die gesamte Organisation geleistet werden.

Es geht also um die Fragen der IT-Strategie und -Organisation sowie der internen Leistungsverrechnung von IT-Services. Soweit die Theorie. Die Praxis in IT-Abteilungen sieht meist anders aus. Obwohl den meisten IT-Verantwortlichen das breite Aufgabenspektrum bewusst ist, wird das Monitoring häufig auf Kontrollfragen eingeengt. Nur wenige Unternehmen verfolgen einen ganzheitlichen Lösungsansatz und ein Großteil der Organisationen weist hinsichtlich des Monitorings erhebliche Optimierungsbedarfe auf. Es gilt: Niemand weiß, warum die Welt so ist, wie sie ist! Daher nützt es nicht, sich in die pure Auswertung von reinen Daten zu flüchten und dabei den Fehler des Big-Data-Lagers zu begehen, Entdeckung mit Erkenntnis zu verwechseln.

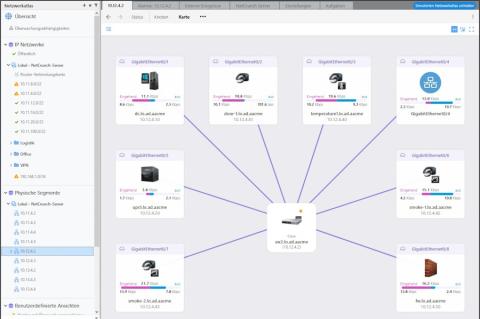

Die Hilflosigkeit vieler Unternehmen beim Umgang mit der IT resultiert aus einem tiefen Nichtverständnis der vernetzten Welt. Die Organisationen fühlen sich einer Entwicklung ausgeliefert, die sie nicht verstehen. Erkenntnis ist das einzige Allheilmittel gegen diese Hilflosigkeit. Aus diesem Grund lässt sich das IT-Monitoring mit dem Besuch bei einem Kardiologen vergleichen. Dieser verfügt über die notwendige Erfahrung und Technologie, um die Systemleistung des Patienten zu dokumentieren. Ähnliches ist auch in größeren Netzwerken, Rechenzentren und IT-Strukturen notwendig. Die IT-Strukturen von Unternehmen und Organisationen bedürfen einer ständigen Überwachung und der Analyse der Performance sowie aller daran angeschlossenen Komponenten und Anwendungen.

Verfügbarkeit und Compliance werden immer teurer

In einer perfekten Welt sind alle Rechenzentren hochgradig redundant aufgebaut. Sie basieren auf einer dualen Systemarchitektur, bei denen die maximale Belastung auf beiden Seiten nie mehr als 50 Prozent beträgt. Durch ein solches System wäre die IT in der Lage, auch Spitzenlasten zu bewältigen, wenn kritische Systeme ausfielen oder für Wartungsarbeiten heruntergefahren werden müssten. In der realen Unternehmenswelt ist eine 100-prozentige Uptime nur möglich, wenn das Unternehmen auch bereit ist, den hierfür notwendigen Preis zu bezahlen. Da die IT den Unternehmen immer viel zu teuer kommt und die Budgets immer knapp kalkuliert sind, gehen die Manager der Serverfarmen immer höhere Risiken ein. Sie hoffen, dass keine Ausfälle auftreten und die kaum redundant ausgelegten Systeme zu nicht mehr als 50 Prozent ausgelastet werden.

Wie die Hochverfügbarkeit ist 100-prozentige Compliance ein hohes Ziel, das sich zwar theoretisch erreichen lässt, jedoch in der Praxis immer wieder scheitert. In vielen Fällen führt auch eine zu sehr an den Buchstaben des Gesetzes ausgelegte Compliance in einem Bereich bereits wieder zu Compliance-Verletzungen in anderen Bereichen. Außerdem ist die Compliance kein starres Regelwerk, sondern verändert sich permanent. Außerdem ist zu bedenken, dass die Regelwerke individuell interpretiert werden. Eine weitere Compliance-Falle besteht darin, dass die Unternehmen zu viele Ressourcen aufwenden, um synchron die Vorschriften über alle Abteilungen hinweg umzusetzen. Dadurch werden zu viele Ressourcen gebunden und andere wichtige Aktivitäten vernachlässigt.

In vielen Unternehmen werden die Compliance-Richtlinien von Stabsstellen erlassen, die nicht notwendigerweise über die Fachkenntnisse der jeweiligen Abteilungen beziehungsweise Bereiche verfügen. Daher kommt es immer wieder dazu, dass die IT mit den Vorschriften kompatibel ist, diese jedoch im krassen Widerspruch zu den Anforderungen der Geschäftsprozesse stehen.

Die IT wird nie genügend Personal bekommen

Natürlich wehrt sich jede IT-Abteilung gegen Budget- und Personalkürzungen. Und Fachwissen ist heute ein rares Gut. Kommt es zu einem Personalabbau, haben die IT-Abteilungen kaum Argumente gegen die Preise von Outsourcern.

Meist wird bei einer Lösung der Personalprobleme im Bereich der IT nicht mehr nachgedacht, sondern pauschal bei Outsourcern das IT-Heil gesucht. Dabei wird oft übersehen, dass die externen Unternehmen auch nur mit Wasser kochen und deren Personal meist nicht kompetenter als das eigene ist. Es geht meist nur um den Abbau von Personal. Wer von der Lohnliste des Unternehmens verschwunden ist, belastet die Bilanzzahlen nicht mehr. Die Aufwände externer Unternehmen, die als Ersatz für das fehlende eigene Personal aufgebracht werden müssen, lassen sich steuertechnisch in der Bilanz als Arbeitskosten ausweisen.

Die IT-Abteilungen in den Unternehmen müssen ihren Wertbeitrag für den Unternehmenserfolg verstehen und diesen intern im Unternehmen gezielt vermarkten. Tue Gutes und sprich darüber! Neben dem Tagesgeschäft muss die Leistung der Unternehmens-IT als persönliche Marke entwickelt werden, damit die Unternehmensleitung versteht, welche realen Werte im Unternehmen vorhanden sind.

Keine Qualität ohne Monitoring

Die chinesische Heilkunst sieht den menschlichen Organismus als miteinander verkettetes Ganzes. Aus diesem Grund werden von den chinesischen Heilern nicht die einzelnen Symptome, sondern der gesamte Körper und Geist behandelt. Analog entwickeln die Hersteller inzwischen Monitoring-Lösungen, die alle Teilbereiche des IT-Systems adäquat bedienen können. Das Ziel besteht darin, nicht nur die Netzwerkkomponenten zu überwachen, sondern auch Ressourcen- und Leistungsreserven zu identifizieren, um sie kostensparend nutzen zu können. Auch hier spiegelt sich die ganzheitliche Betrachtung wider.

Die Initialzündung für Monitoring-Projekte ist in den meisten Fällen auf geänderte Anforderungen an die Systeminfrastruktur zurückzuführen. Auch gehen die Anstöße auffallend häufig vom Topmanagement aus. Als wesentliche Beweggründe für die Einführung von Monitoring-Lösungen gelten Effizienzsteigerungen durch reduzierte IT-Kosten und der Abbau von Parallelstrukturen. Fast der Hälfte aller Monitoring-Projekte versucht, mit diesen Hilfsmitteln das Risiko-Management zu verbessern.

Einschlägige Befragungen weisen jedoch nach, dass das Monitoring der IT-Projekte in den weitaus meisten Unternehmen zu kurz kommt. Nur ein geringer Anteil der Unternehmen misst den Erfolg der IT qualitativ, die anderen Unternehmen urteilen lediglich nach quantitativen Kriterien. Ohne eine systematische Dokumentation beziehungsweise ein kontinuierliches Monitoring bleiben Effizienzgewinne, höhere Datensicherheit oder verbesserte Verfügbarkeiten jedoch nicht belegbare Behauptungen. Der reibungslose Betrieb einer IT-Infrastruktur erfordert von den IT-Abteilungen die Überwachung, regelmäßige Kontrolle und die Sicherstellung aller signifikanten Betriebsparameter auf allen an den Prozessen beteiligten Komponenten.

Im zweiten Teil des Artikels gehen wir auf die Aufgaben des Monitorings, die Anforderungen an Überwachungswerkzeuge und Monitoring in der Cloud ein.

Der dritte Teil der Serie beschäftigt sich mit Sicherheitsmonitoring und der Überwachung von Echtzeitapplikationen.