Lesezeit

2 Minuten

Backup und Restore in virtualisierten Umgebungen

In unserer Grundlagen-Rubrik erklären wir wichtige Aufgaben und Technologien aus dem Arbeitsalltag eines Netzwerk- und Systemadministrators. Hier erfahren Sie anhand prägnanter Erklärungen zu den wichtigsten Begriffen des jeweiligen Themenfeldes Hintergründe und Zusammenhänge in kompakter, praxisnaher Form.

Neben allen Vorzügen erzeugen virtuelle Landschaften zusätzlichen administrativen Aufwand. Hierzu zählt insbesondere die Sicherung der virtuellen Maschinen (VM). Denn die vielfältigen Vorteile bewirken, dass große Datenmengen in den unterschiedlichsten Szenarien im Umlauf sind. Und wer VMs nicht oder mit der am bequemsten erscheinenden Methode sichert, riskiert einen Datenverlust. In diesem Grundlagen-Artikel beleuchten wir, welche sinnvollen Backup- und Restore-Methoden in virtualisierten Umgebungen existieren.

Neben allen Vorzügen erzeugen virtuelle Landschaften zusätzlichen administrativen Aufwand. Hierzu zählt insbesondere die Sicherung der virtuellen Maschinen (VM). Denn die vielfältigen Vorteile bewirken, dass große Datenmengen in den unterschiedlichsten Szenarien im Umlauf sind. Und wer VMs nicht oder mit der am bequemsten erscheinenden Methode sichert, riskiert einen Datenverlust. In diesem Grundlagen-Artikel beleuchten wir, welche sinnvollen Backup- und Restore-Methoden in virtualisierten Umgebungen existieren.

In virtualisierten Umgebungen werden die Hosts als Träger mehrerer virtueller Server sowie der zentrale Storage zur Achillesferse der IT. Fällt die physische Instanz aus, zieht sie – ohne ordentliche Sicherung – all ihre darauf sitzenden virtuellen Gäste in Mitleidenschaft. Die VMs selbst laufen zwar auf separaten logischen Ebenen, trotzdem können Nutzer die einzelnen VMs sichern, indem sie ein Backup des gesamten physischen Host anfertigen. Allerdings müsste dann bei jedem Datenverlust auch der gesamte Server wiederhergestellt werden.

Diese Methode des Host-Backups hat den Nachteil, dass VMs im produktiven Einsatz einen sich ständig ändernden Satz an Benutzerdaten, Einstellungen und Anwendungen mitbringen. Es besteht also die Gefahr, dass durch ein einfaches Backup über den Host diese Informationen und damit der vollständige Status einer laufenden VM nicht gesichert werden. Um ein konsistentes Backup zu erstellen, müsste also jede VM für den Datensicherungsprozess in den Suspend-Modus gesetzt oder besser noch heruntergefahren werden – für einen Server in einer produktiven Umgebung keine wirklich realistische Option. Zum Schutz der Daten in einer virtuellen Infrastruktur kommen daher derzeit vor allem zwei grundsätzliche Backup-Methoden zum Einsatz:

Agentenbasiertes Backup

Das agentenbasierte Backup in einer virtuellen Umgebung stellt sich nicht anders dar als das in einer physischen. Auf jeder VM kommt ein Backup-Agent zum Einsatz, der anhand eines definierten Zeitplans startet. In diesem Fall werden VMs File-basiert auf dem Backup-Server gespeichert. Der Vorteil bei dieser ausgereiften und bekannten Methode besteht darin, dass einzelne Dateien und Bestandteile, wie etwa auch eine E-Mail oder ein einzelner Datensatz aus einer Datenbank, problemlos wiederhergestellt werden.

Nachteilig ist, dass sich die VM als Ganzes selbst nicht sichern lassen. So ist im Fall einer fehlerhaften VM der entsprechende Server komplett neu aufzusetzen und einzurichten. Erst dann kann der Administrator die gesicherten Daten wieder zurückspielen – ein zeitaufwändiges Verfahren, besonders wenn es um viele Restore-Objekte geht. Hinzu kommt, dass die Last auf dem Host bei mehreren gleichzeitigen Backups drastisch ansteigt und somit die Leistungsfähigkeit aller Systeme auf dem jeweiligen Host beeinträchtigen kann.

Agentenloses Backup über Hersteller-API

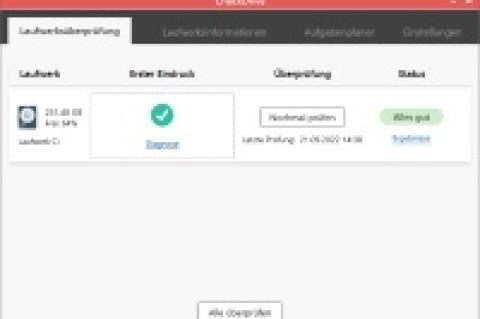

Über das agentenbasierte Backup hinaus existieren noch Backuplösungen, die auf eine zentrale Storage-Schnittstelle wie beispielsweise die "vStorage APIs for Data Protection" (VADP) von VMware zugreifen. Die einfachste Variante hierbei ist, einen Snapshot der VM zu erstellen und danach das Image als Vollbackup zu sichern. Für diese Snapshot-Sicherung kommt es nicht zur Installation eines Agenten pro VM und das Backup verläuft unabhängig vom Betriebssystem der VM. Lohnenswert wird die Verwendung etwa der vStorage-APIs, wenn die Backuplösung das so genannte Changed Block Tracking verwendet. Hierbei werden nur Datenblöcke gesichert, die seit der letzten Sicherung dazugekommen sind. Dadurch lassen sich inkrementelle und differentielle Datensicherungen realisieren, der Datenverkehr lässt sich verringern und die Performance erhöhen.

Nachteil der agentenlosen Sicherung sind die beschränkten Möglichkeiten, die der VM zur Verfügung stehen. Zwar kann sie Images und Snapshots erstellen und übergeben, aber das Backup von Anwendungen und Datenbanken erfordert umfassendere Maßnahmen. Zudem gehen Änderungen, die sich zum Zeitpunkt des Snapshots im Speicher, aber noch nicht auf der Festplatte befinden, verloren. Für als Standard definierte Betriebssysteme und Anwendungen kann sich die agentenlose Sicherung mit Snapshots eignen. Wer jedoch unter abweichenden Bedingungen zuverlässige Datenkonsistenz erzielen will, muss weitere Skripte zum Erfassen des Zustandes vor dem Einfrieren und nach dem Auftauen für VMs unter Windows und Linux konfigurieren. Da diese Skripte nicht Teil eines automatisierten Prozesses der Backup-Software sind, müssen Skripte von der Backup-Software erstellt oder vom Administrator manuell installiert, verwaltet und gepflegt werden.

Fazit

Während das Desaster Recovery einer kompletten VM aus einer Snapshot-Sicherung sehr schnell und einfach erfolgt, würde die Wiederherstellung von Anwendungen und Datenbanken aus Snapshot-Sicherungen eine Reihe komplexer Prozesse erfordern. Backups, die mit einem Agenten innerhalb der VM erzeugt wurden, ermöglichen ein einfaches Point-in-Time-Recovery von Anwendungen und Datenbanken – und damit eine erfolgreiche Wiederherstellung. Zudem lassen sich die Sicherungsprozesse flexibel planen. Im Sinne einer hohen Datenverfügbarkeit empfiehlt sich daher ein duales Backup-Konzept und eine Datensicherung, die ein duales Konzept ohne Zusatzkosten unterstützt.

Mehr zum Thema "Backup & Verfügbarkeit" finden Sie in der April-Ausgabe 2012 des IT-Administrator.

ln

Diese Methode des Host-Backups hat den Nachteil, dass VMs im produktiven Einsatz einen sich ständig ändernden Satz an Benutzerdaten, Einstellungen und Anwendungen mitbringen. Es besteht also die Gefahr, dass durch ein einfaches Backup über den Host diese Informationen und damit der vollständige Status einer laufenden VM nicht gesichert werden. Um ein konsistentes Backup zu erstellen, müsste also jede VM für den Datensicherungsprozess in den Suspend-Modus gesetzt oder besser noch heruntergefahren werden – für einen Server in einer produktiven Umgebung keine wirklich realistische Option. Zum Schutz der Daten in einer virtuellen Infrastruktur kommen daher derzeit vor allem zwei grundsätzliche Backup-Methoden zum Einsatz:

Agentenbasiertes Backup

Das agentenbasierte Backup in einer virtuellen Umgebung stellt sich nicht anders dar als das in einer physischen. Auf jeder VM kommt ein Backup-Agent zum Einsatz, der anhand eines definierten Zeitplans startet. In diesem Fall werden VMs File-basiert auf dem Backup-Server gespeichert. Der Vorteil bei dieser ausgereiften und bekannten Methode besteht darin, dass einzelne Dateien und Bestandteile, wie etwa auch eine E-Mail oder ein einzelner Datensatz aus einer Datenbank, problemlos wiederhergestellt werden.

Nachteilig ist, dass sich die VM als Ganzes selbst nicht sichern lassen. So ist im Fall einer fehlerhaften VM der entsprechende Server komplett neu aufzusetzen und einzurichten. Erst dann kann der Administrator die gesicherten Daten wieder zurückspielen – ein zeitaufwändiges Verfahren, besonders wenn es um viele Restore-Objekte geht. Hinzu kommt, dass die Last auf dem Host bei mehreren gleichzeitigen Backups drastisch ansteigt und somit die Leistungsfähigkeit aller Systeme auf dem jeweiligen Host beeinträchtigen kann.

Agentenloses Backup über Hersteller-API

Über das agentenbasierte Backup hinaus existieren noch Backuplösungen, die auf eine zentrale Storage-Schnittstelle wie beispielsweise die "vStorage APIs for Data Protection" (VADP) von VMware zugreifen. Die einfachste Variante hierbei ist, einen Snapshot der VM zu erstellen und danach das Image als Vollbackup zu sichern. Für diese Snapshot-Sicherung kommt es nicht zur Installation eines Agenten pro VM und das Backup verläuft unabhängig vom Betriebssystem der VM. Lohnenswert wird die Verwendung etwa der vStorage-APIs, wenn die Backuplösung das so genannte Changed Block Tracking verwendet. Hierbei werden nur Datenblöcke gesichert, die seit der letzten Sicherung dazugekommen sind. Dadurch lassen sich inkrementelle und differentielle Datensicherungen realisieren, der Datenverkehr lässt sich verringern und die Performance erhöhen.

Nachteil der agentenlosen Sicherung sind die beschränkten Möglichkeiten, die der VM zur Verfügung stehen. Zwar kann sie Images und Snapshots erstellen und übergeben, aber das Backup von Anwendungen und Datenbanken erfordert umfassendere Maßnahmen. Zudem gehen Änderungen, die sich zum Zeitpunkt des Snapshots im Speicher, aber noch nicht auf der Festplatte befinden, verloren. Für als Standard definierte Betriebssysteme und Anwendungen kann sich die agentenlose Sicherung mit Snapshots eignen. Wer jedoch unter abweichenden Bedingungen zuverlässige Datenkonsistenz erzielen will, muss weitere Skripte zum Erfassen des Zustandes vor dem Einfrieren und nach dem Auftauen für VMs unter Windows und Linux konfigurieren. Da diese Skripte nicht Teil eines automatisierten Prozesses der Backup-Software sind, müssen Skripte von der Backup-Software erstellt oder vom Administrator manuell installiert, verwaltet und gepflegt werden.

Fazit

Während das Desaster Recovery einer kompletten VM aus einer Snapshot-Sicherung sehr schnell und einfach erfolgt, würde die Wiederherstellung von Anwendungen und Datenbanken aus Snapshot-Sicherungen eine Reihe komplexer Prozesse erfordern. Backups, die mit einem Agenten innerhalb der VM erzeugt wurden, ermöglichen ein einfaches Point-in-Time-Recovery von Anwendungen und Datenbanken – und damit eine erfolgreiche Wiederherstellung. Zudem lassen sich die Sicherungsprozesse flexibel planen. Im Sinne einer hohen Datenverfügbarkeit empfiehlt sich daher ein duales Backup-Konzept und eine Datensicherung, die ein duales Konzept ohne Zusatzkosten unterstützt.

Mehr zum Thema "Backup & Verfügbarkeit" finden Sie in der April-Ausgabe 2012 des IT-Administrator.

ln